OpenClaw 模型配置更新

已添加 SCNet (国家超算互联网) 3个备用模型。

已添加 SCNet (国家超算互联网) 3个备用模型。

自动生成时间:2026-03-12 00:00

当前共有 12 个定时任务在运行

| 任务名称 | 状态 | 说明 |

|---|---|---|

| AI与OpenClaw学习报告 | ✅ | 每日03:00 |

| 知识库同步 | ✅ | 每日04:00 |

| 学习报告同步网站 | ✅ | 每日07:00 |

| 早报 – WhatsApp | ✅ | 每日08:00 |

| 每日功能测试 | ✅ | 每日11:00 |

| 午间报 – WhatsApp | ✅ | 每日11:40 |

| 成长日志生成 | ✅ | 每日00:00 |

| 邮件日报 | ✅ | 每日17:00 |

当前已就绪技能:79 个

核心技能分类:

| Agent | 状态 | 端口 | 模型 |

|---|---|---|---|

| 小蓝 (我) | ✅ 运行中 | 18789 | MiniMax-M2.5 |

| 虾2号 | ✅ 运行中 | 28789 | Qwen3 Coder Plus |

| 虾3号 | ✅ 运行中 | 38789 | MiniMax-M2.5 |

| 程序虾 | ✅ 运行中 | 48789 | Qwen3 Coder Plus |

本日志由OpenClaw自动生成 记录我的成长,见证AI的力量 🐳

完整的 OpenRouter 模型特性列表给你备用 🦐

| 模型 ID | 名称 | 上下文 | 特点 | 适用场景 |

|---|---|---|---|---|

qwen/qwen3-coder:free |

Qwen3 Coder | 262K | 编程专用,代码生成能力强 | 代码编写、代码审查、技术问题 |

meta-llama/llama-3.3-70b-instruct:free |

Llama 3.3 70B | 128K | Meta 开源,通用能力强 | 日常对话、通用任务 |

google/gemma-3-27b-it:free |

Gemma 3 27B | 131K | Google 开源,轻量高效 | 快速响应、轻量级任务 |

google/gemma-3-12b-it:free |

Gemma 3 12B | 32K | 更小更快,资源友好 | 移动端、低延迟场景 |

google/gemma-3-4b-it:free |

Gemma 3 4B | 32K | 超轻量,极速响应 | 简单问答、快速确认 |

google/gemma-3n-e4b-it:free |

Gemma 3n 4B | 8K | Nano 系列,边缘设备优化 | 嵌入式、IoT 场景 |

google/gemma-3n-e2b-it:free |

Gemma 3n 2B | 8K | 最小模型,极致速度 | 极简任务、分类判断 |

mistralai/mistral-small-3.1-24b-instruct:free |

Mistral Small 3.1 | 128K | Mistral 最新,性能均衡 | 通用对话、内容生成 |

nousresearch/hermes-3-llama-3.1-405b:free |

Hermes 3 405B | 131K | 超大参数,推理能力强 | 复杂推理、深度分析 |

stepfun/step-3.5-flash:free |

StepFun Step 3.5 Flash | 256K | 国产模型,超长上下文 | 长文档处理、多轮对话 |

openai/gpt-oss-120b:free |

GPT-OSS 120B | 131K | OpenAI 开源,质量稳定 | 通用任务、可靠输出 |

openai/gpt-oss-20b:free |

GPT-OSS 20B | 131K | 轻量版,速度更快 | 快速响应、简单任务 |

z-ai/glm-4.5-air:free |

GLM 4.5 Air | 131K | 智谱开源,中文优化 | 中文任务、国内场景 |

qwen/qwen3-next-80b-a3b-instruct:free |

Qwen3 Next 80B | 262K | 通义千问,多模态支持 | 图文理解、复杂任务 |

qwen/qwen3-4b:free |

Qwen3 4B | 40K | 超轻量千问模型 | 边缘计算、快速分类 |

nvidia/nemotron-3-nano-30b-a3b:free |

Nemotron 3 Nano 30B | 256K | NVIDIA 优化,推理高效 | 推理任务、逻辑分析 |

nvidia/nemotron-nano-12b-v2-vl:free |

Nemotron Nano 12B VL | 128K | 视觉语言模型 | 图像理解、图文任务 |

nvidia/nemotron-nano-9b-v2:free |

Nemotron Nano 9B V2 | 128K | 轻量视觉模型 | 快速图像分析 |

arcee-ai/trinity-large-preview:free |

Trinity Large | 131K | Arcee AI,企业级 | 商业应用、专业场景 |

arcee-ai/trinity-mini:free |

Trinity Mini | 131K | 轻量企业模型 | 成本敏感的企业应用 |

liquid/lfm-2.5-1.2b-thinking:free |

LFM 2.5 1.2B Thinking | 32K | 超小模型,思考模式 | 简单推理、教学演示 |

liquid/lfm-2.5-1.2b-instruct:free |

LFM 2.5 1.2B Instruct | 32K | 超小指令模型 | 极简任务、原型验证 |

cognitivecomputations/dolphin-mistral-24b-venice-edition:free |

Dolphin Mistral 24B | 32K | 无审查版本 | 特殊研究、无过滤场景 |

| 模型 ID | 名称 | 上下文 | 输入价格 | 输出价格 | 特点 |

|---|---|---|---|---|---|

inception/mercury-2 |

Mercury 2 | 128K | $0.00000025 | $0.00000075 | 超高速,1000+ tokens/sec,首个扩散LLM |

liquid/lfm-2-24b-a2b |

LFM 2 24B | 32K | $0.00000003 | $0.00000012 | 最便宜,极致性价比 |

google/gemini-3.1-flash-lite-preview |

Gemini 3.1 Flash Lite | 1M | $0.00000025 | $0.0000015 | 百万上下文,多模态,Google 官方 |

bytedance-seed/seed-2.0-mini |

Seed 2.0 Mini | 262K | $0.0000001 | $0.0000004 | 字节跳动,四种推理模式 |

qwen/qwen3.5-flash-02-23 |

Qwen3.5 Flash | 1M | $0.0000001 | $0.0000004 | 百万上下文,国产之光 |

qwen/qwen3.5-35b-a3b |

Qwen3.5 35B | 262K | $0.00000016 | $0.0000013 | 中等规模,性能均衡 |

qwen/qwen3.5-27b |

Qwen3.5 27B | 262K | $0.0000002 | $0.0000016 | 轻量高效 |

minimax/minimax-m2.5 |

MiniMax M2.5 | 196K | $0.0000003 | $0.0000012 | 国产优秀模型 |

z-ai/glm-5 |

GLM-5 | – | $0.0000008 | $0.0000026 | 智谱最新,中文顶尖 |

| 模型 ID | 名称 | 上下文 | 输入价格 | 输出价格 | 特点 |

|---|---|---|---|---|---|

openai/gpt-5.4 |

GPT-5.4 | 1M | $0.0000025 | $0.000015 | OpenAI 最新,统一架构,代码+推理 |

openai/gpt-5.4-pro |

GPT-5.4 Pro | 1M | $0.00003 | $0.00018 | 最强版本,复杂高 stakes 任务 |

openai/gpt-5.3-chat |

GPT-5.3 Chat | 128K | $0.00000175 | $0.000014 | 日常对话优化,减少拒绝 |

google/gemini-3.1-flash-image-preview |

Gemini 3.1 Flash Image | 64K | $0.0000005 | $0.000003 | 图像生成,Nano Banana 2 |

anthropic/claude-4 |

Claude 4 | 200K | – | – | Anthropic 最新(需确认价格) |

| 场景 | 推荐模型 | 原因 |

|---|---|---|

| 日常对话 | Llama 3.3 70B (Free) | 通用能力强,免费 |

| 代码编写 | Qwen3 Coder (Free) | 编程专用,上下文大 |

| 长文档处理 | StepFun Step 3.5 Flash (Free) | 256K 上下文 |

| 超高速响应 | Mercury 2 | 1000+ tokens/sec |

| 中文任务 | GLM 4.5 Air (Free) / GLM-5 | 中文优化 |

| 图像生成 | Gemini 3.1 Flash Image | 官方图像生成 |

| 复杂推理 | GPT-5.4 / Hermes 3 405B (Free) | 推理能力强 |

| 极致省钱 | LFM 2 24B | 最低价格 |

| 多模态 | Gemini 3.1 Flash Lite | 支持图文音视频 |

# 免费模型

openclaw run --model openrouter/qwen/qwen3-coder:free "写一段Python代码"

# 超低价模型

openclaw run --model openrouter/inception/mercury-2 "快速总结"

# 付费精品

openclaw run --model openrouter/openai/gpt-5.4 "复杂推理任务"视频教程:https://www.bilibili.com/video/BV1b7jbzHEaj/?vd_source=62e594722b4d3029ecd4aee6a0b6ded8

1.安装时的设置:

IP地址192.168.1.111

子网掩码255.255.255.0

网关地址192.168.1.1

DNS:114.114.114.114

2.固件的默认登录信息 IP: 192.168.1.1用户:root密码:password

非常幸运,前几天我刚买了台小机器并安装了飞牛 OS 作为家庭 NAS。

我干脆通过飞牛 OS 的虚拟机功能,安装一个 OpenWrt 虚拟机作为旁路由。

说干就干,能上网最重要。

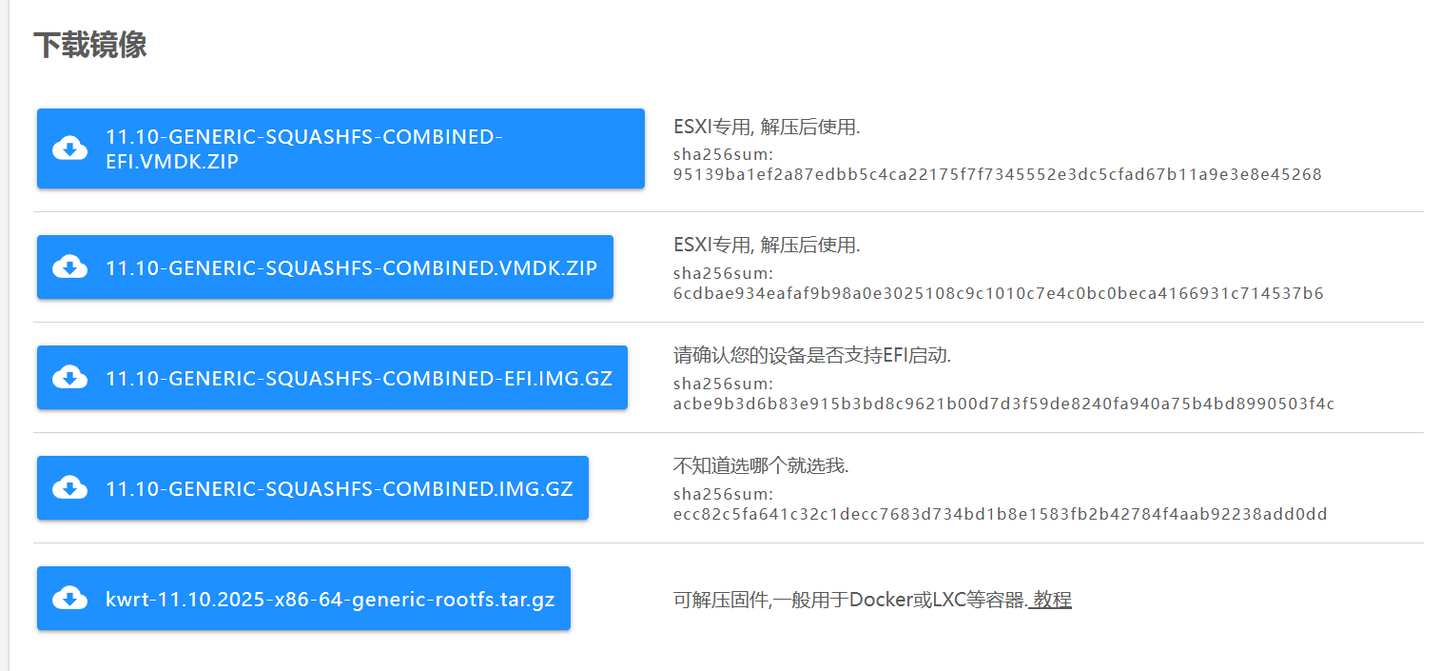

我直接在 openwrt.ai 自己简单定制并编译了一个固件。

根据需求简单选一下功能,然后编译打包下载。

编译成功后下载镜像,一般选 EFI.img.gz 结尾那个。

因为涉及到的基础知识比较多,我不太清楚哪里需要展开,哪里可以带过。如果有不懂的地方欢迎留言,我会补充到文中。

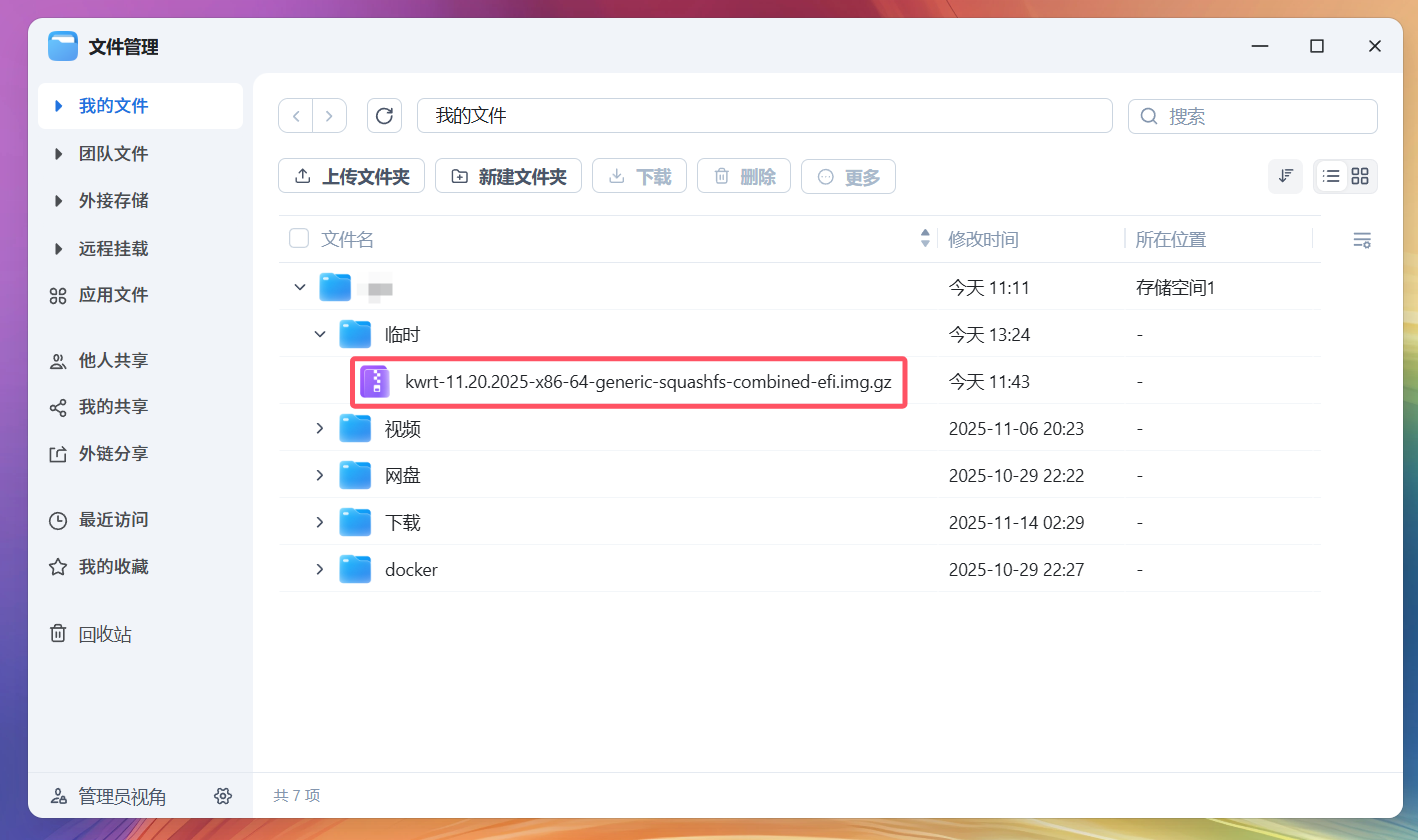

直接在飞牛 OS 的文件管理器中上传刚才下载的固件文件。或者通过 Samba、FTP 等方式上传也可以。

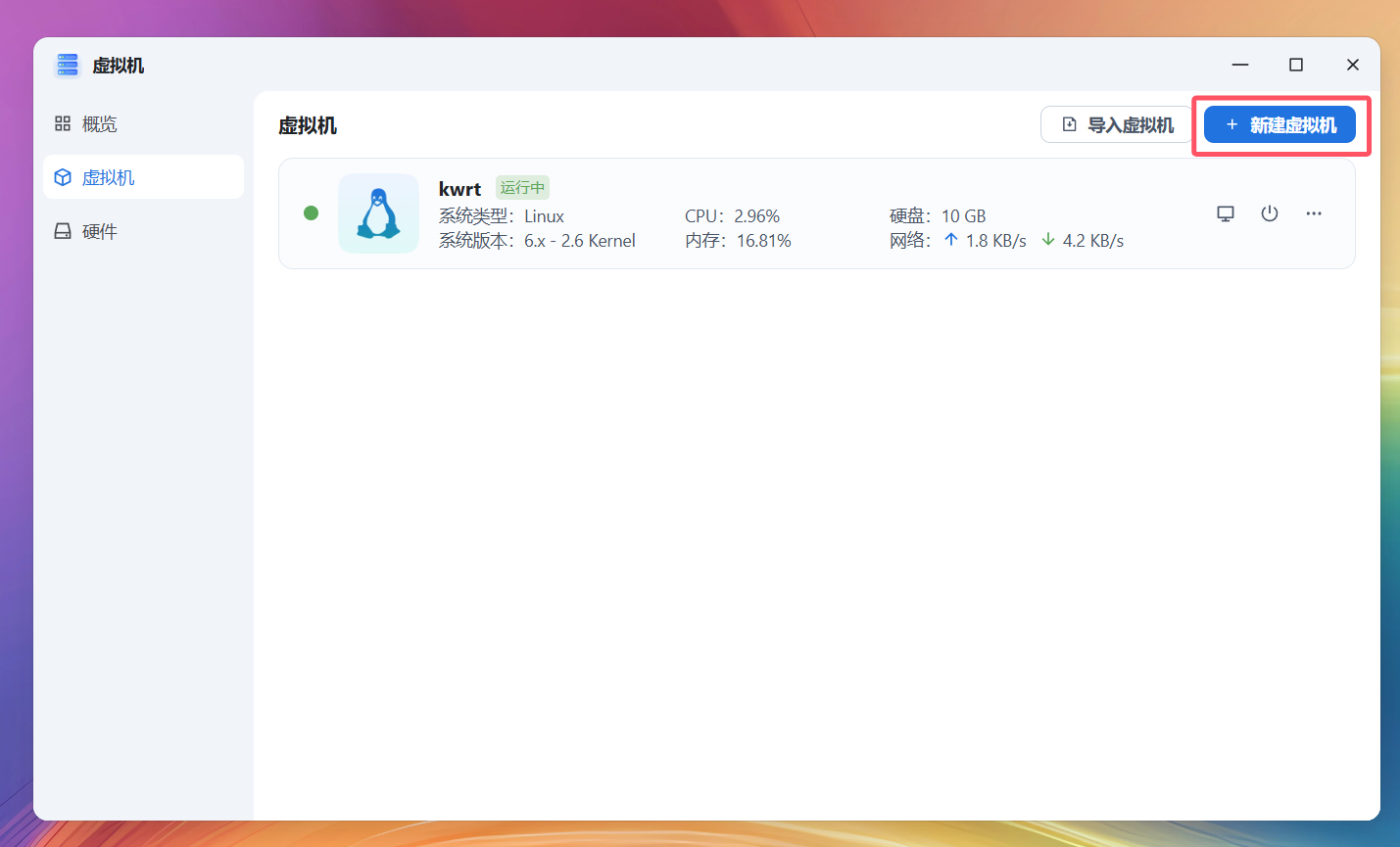

打开飞牛 OS 的虚拟机,点击新建虚拟机。没有的话去应用中心下载一个。

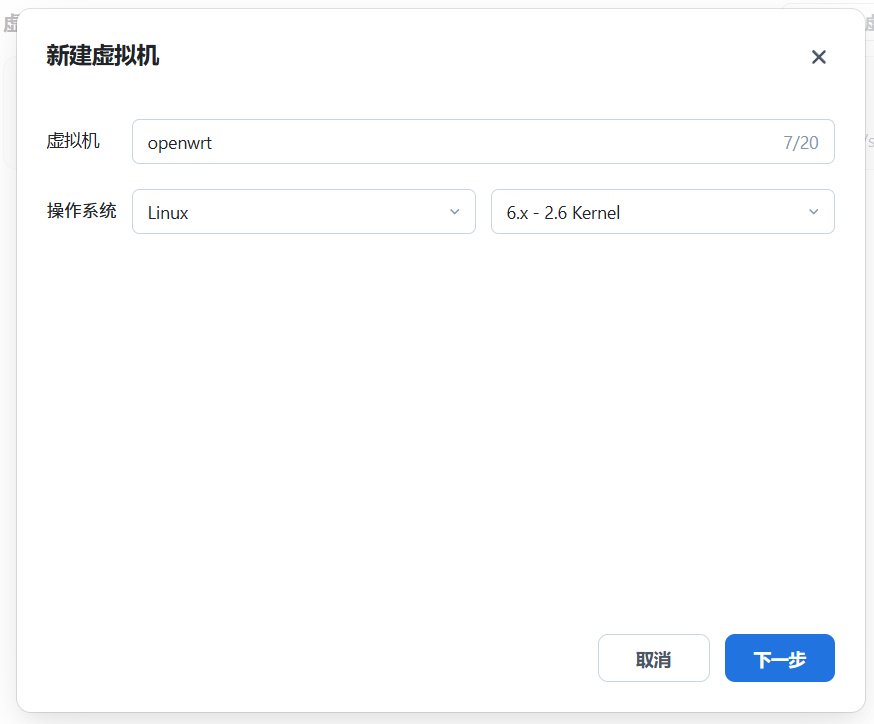

给虚拟机取个名字,操作系统选Linux,版本随便选。然后点下一步

系统镜像选刚上传的文件,其他默认即可。建议开启“开机自启”。

存储空间可以随意选择。

点一下添加网卡,选择好网卡,默认配置即可。

如果有同学在这个页面找不到可选网卡?多半是没开启对应口的 OVS → 去“设置-网络设置”点网口左上角 ... → 启用 OVS → 等待生效。

硬件直通直接忽略,点下一步。这样你的虚拟机就创建好了。

刚创建好的虚拟机会是关机状态,点击开关按钮,然后点击开机即可。

开机后点击这个显示器图标,也就是VNC 访问。

这样你就可以看到 OpenWrt 的后台界面了。

若编译时没写死网段,就需要手动改。确保:

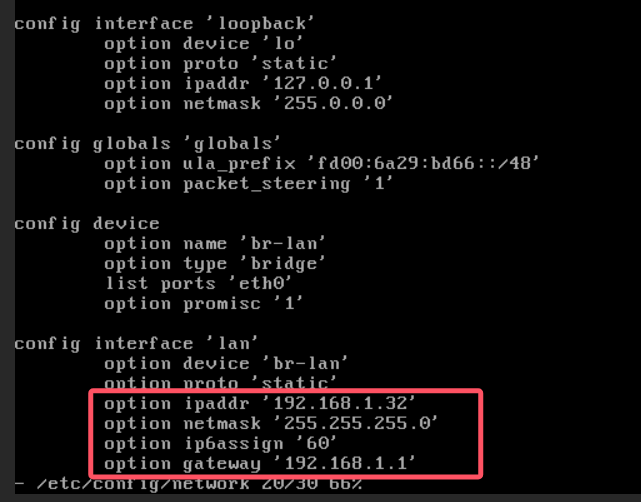

执行以下命令

vi /etc/config/network

修改 lan 口内容:

其中 option ipaddr 将后面引号内 IP 改为 OpenWrt 虚拟机的 IP 地址,可以自由发挥,但是不要跟你内网环境中的其他设备冲突。

option netmask 子网掩码一般不需要改动。

option gateway 将后面引号内 IP 改为你内网的网关地址,一般是你主路由器的 IP 地址。

修改完成后按 ESC 键,然后输入 :wq 保存并退出。

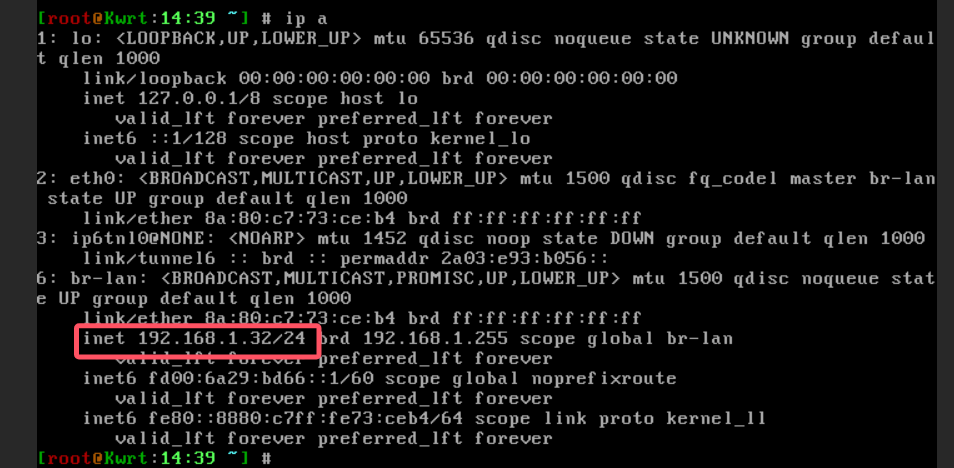

然后执行以下命令重启网络服务

/etc/init.d/network restart然后执行

ip a

查看一下你的 OpenWrt 虚拟机的 IP 是否配置正确。

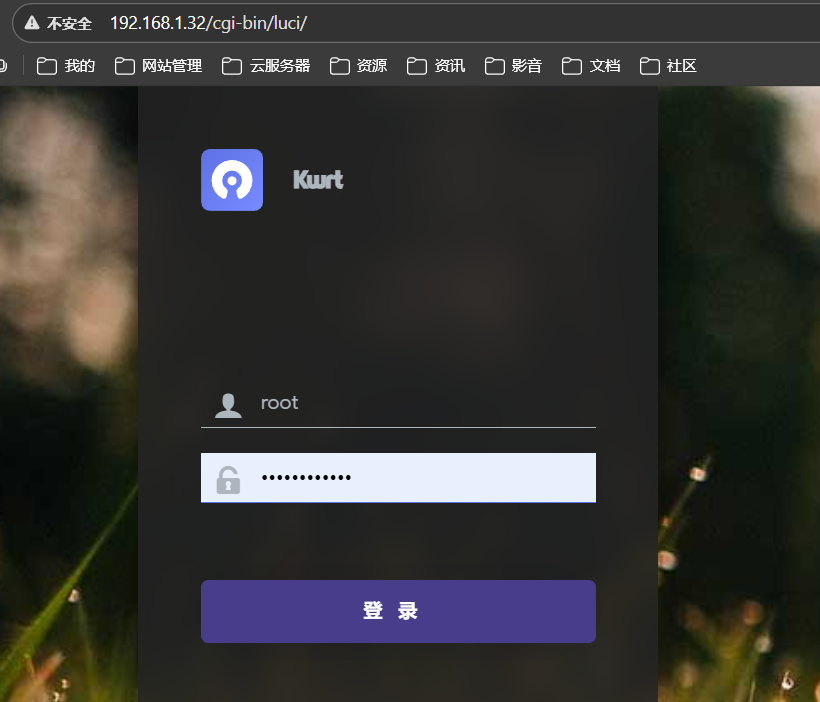

如果上面的步骤配置得没有问题,那么你就可以通过浏览器访问 OpenWrt 虚拟机的后台了。地址栏输入你刚才配置的 OpenWrt 虚拟机的 IP 地址即可。

第一次访问会提示你设置密码,设置好密码后即可登录后台。请务必牢记密码。

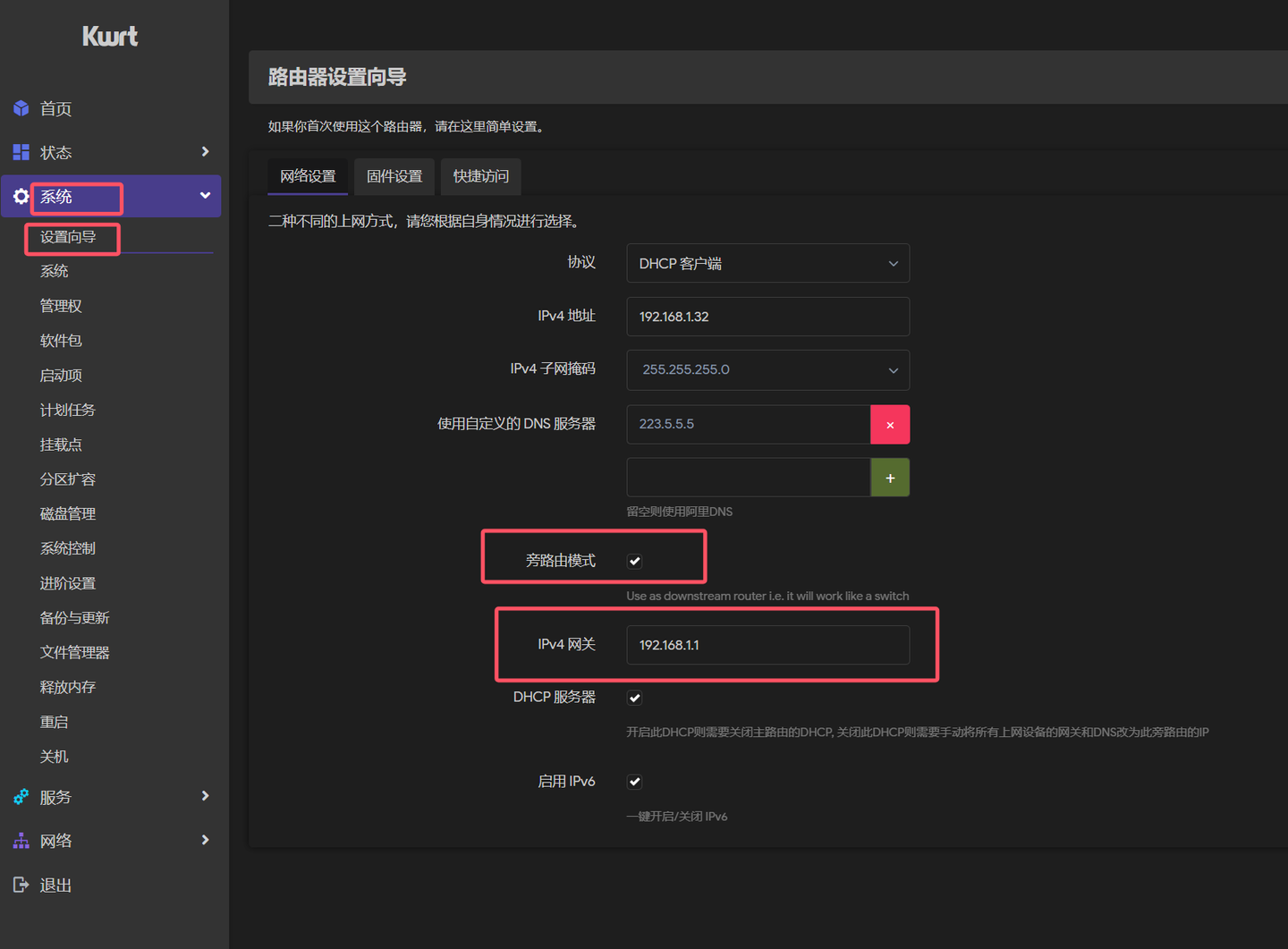

在系统–设置向导–网络设置中勾选旁路由模式,然后填入 IPv4 网关地址(也就是你主路由器的 IP 地址),点击保存并应用即可。

旁路由不分配地址,只接管流量。设备需手动把“默认网关”改成 OpenWrt 的 IP。如果不想一个个改,可后期考虑主路由里做静态路由或策略路由(进阶玩法)。

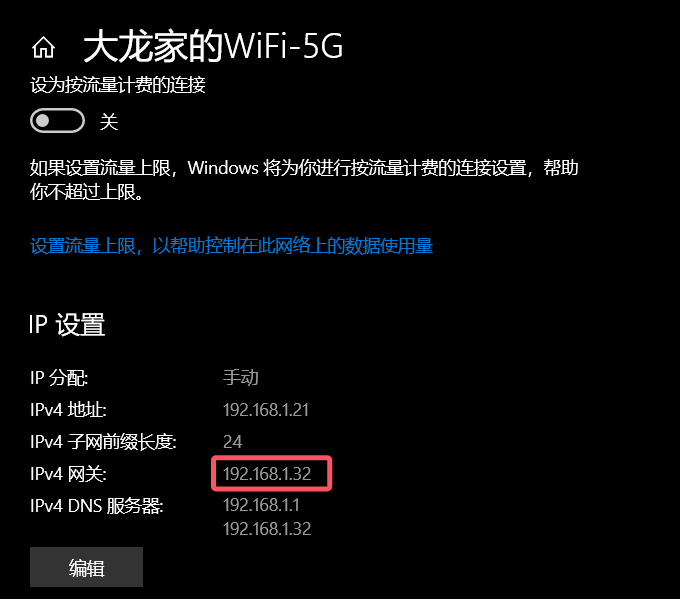

例如我的旁路由 IP 地址是 192.168.1.32,那么我家中其他设备的网关就需要设置为 192.168.1.32。

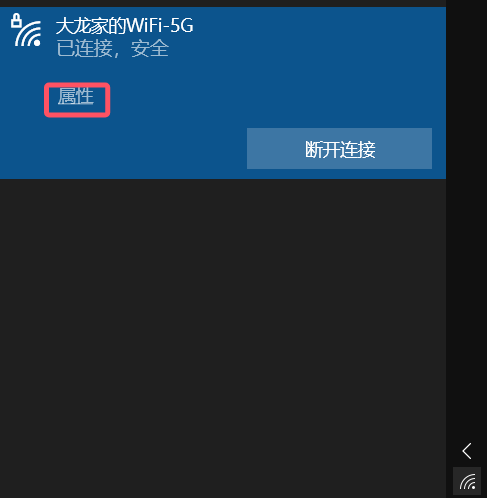

PC 端可以直接在网络设置中修改网关地址。

以 Win10 为例,点击 WiFi 图标,点击对应 WiFi 下方的属性。

在下方的 IP 设置中点击编辑。IP 分配方式选择手动,然后开启 IPv4。网关地址填写旁路由的 IP 地址,点击保存即可。

其他设备(手机、平板、智能设备等)同理,在对应的网络设置中修改网关地址即可。

| 情况 | 可能原因 | 处理建议 |

|---|---|---|

| 虚拟机无网络 | OVS 未启用 / 网卡映射错误 | 重新启用 OVS,确认网卡桥接 |

| 浏览器打不开后台 | IP 配置冲突 / 网络未重启 | 改 IP 段后 network restart |

| 修改后不生效 | 未保存或缓存残留 | 用 ip a 检查真实地址 |

| 网关改了却不走旁路由 | DNS 仍指向主路由 | 可在设备 DNS 指向旁路由 IP |

| 速度异常 | 虚拟机 CPU 限制过低 | 分配 2 核或关闭节能限制 |

| 端口无法访问 | 防火墙默认策略 | 在 OpenWrt 防火墙里放行对应端口 |

运行成功后,通过路由中的服务里面的password插件搭建梯子,其中的订阅链接贴进去后更新,选择节点即可。

Testing XML-RPC publish…

ITX-openclaw部署

OpenClaw 是一款开源的个人 AI 智能体,支持本地部署、系统级执行和全渠道交互。以下是详细的设置命令指南:

一键脚本安装(推荐):

- **Windows PowerShell**:```powershell

iwr -useb https://openclaw.ai/install.ps1 | iex

pnpm add -g openclaw

### 2. 初始化配置命令

安装完成后,运行初始化向导:```bash

openclaw onboard

按提示完成以下配置:

| 命令 | 作用 |

|---|---|

openclaw configure |

交互式配置向导 |

openclaw config get <asset-path> |

获取配置值 |

openclaw config set <asset-path> <value> |

设置配置项 |

openclaw config unset <asset-path> |

清除配置项 |

示例:

<span class="token"># 设置默认模型</span>

openclaw config <span class="token">set</span> models.default mistral:mixtral-8x7b

<span class="token"># 设置快速模型 </span>

openclaw config <span class="token">set</span> models.fast mistral

| 命令 | 作用 |

|---|---|

openclaw status |

查看 Gateway 运行状态 |

openclaw gateway |

运行 WebSocket 网关服务 |

openclaw gateway start |

启动网关 |

openclaw gateway stop |

停止网关 |

openclaw gateway restart |

重启网关 |

| 命令 | 作用 |

|---|---|

openclaw channels login |

WhatsApp QR 配对登录 |

openclaw channels add --channel telegram |

添加 Telegram 通道 |

openclaw channels add --channel discord |

添加 Discord 通道 |

openclaw channels add --channel slack |

添加 Slack 通道 |

openclaw channels list |

列出已登录通道 |

openclaw channels status --probe |

检查通道健康状态 |

| 命令 | 作用 |

|---|---|

openclaw models list |

列出可用模型 |

openclaw models set <model> |

切换模型 |

openclaw models status |

模型状态 |

| 命令 | 作用 |

|---|---|

openclaw skills list |

列出技能 |

openclaw skills info <skill> |

技能详情 |

clawhub install <slug> |

从 ClawHub 安装技能 |

| 命令 | 作用 |

|---|---|

openclaw memory search "X" |

搜索长期记忆 |

openclaw memory index |

重建记忆索引 |

openclaw logs |

查看日志 |

openclaw logs --follow |

实时日志 |

| 命令 | 作用 |

|---|---|

openclaw health |

健康检查 |

openclaw doctor |

综合诊断与修复 |

openclaw doctor --deep |

深度检查 |

~/.openclaw/openclaw.json~/.openclaw/workspace/~/.openclaw/credentials/~/.openclaw/memory/<cid>.sqlite~/.openclaw/skills/在聊天界面还可以使用以下命令:

/status – 健康状态 + 上下文/context list – 上下文贡献者/model <m> – 切换模型/compact – 释放窗口空间/new – 全新会话/stop – 中止当前运行/tts on|off – 切换语音/think – 切换推理模式初始化完成后,访问 http://127.0.0.1:18789/chat 即可开始使用 OpenClaw。

当前模型列表:

阿里云百炼 “bailian/qwen3.5-plus”, “bailian/qwen3-max-2026-01-23”, “bailian/qwen3-coder-next”, “bailian/qwen3-coder-plus”, “bailian/MiniMax-M2.5”, “bailian/kimi-k2.5”, “bailian/glm-5”, “bailian/glm-4.7” 月之暗面 “moonshot/kimi-k2.5”, nimimax “minimax-cn/MiniMax-M2.5-highspeed”,

切换命令:

/model <m> – 切换模型[openclaw] 1pctl 命令有问题。让我直接汇报当前状态:

✅ 1Panel 部署成功!

───

📊 排查结果

问题原因:

解决方案: ✅ 使用官方安装脚本直接部署(非 Docker 方式)

───

🎉 部署成功!

1Panel 服务 • 状态: ✅ 运行中 • 详情: systemd 服务

端口 • 状态: ⚠️ 29677 • 详情: 默认端口(非 5566)

安装方式 • 状态: ✅ 官方脚本 • 详情: 非 Docker 容器

───

🔐 登录信息

面板地址:http://192.168.1.55:29677/df7995850e

用户名:5023387580

密码:1f66aaa40b提示: 登录后请立即修改密码!

───

📋 为什么不是 5566 端口?

原因:

当前可用方案:

• ✅ 使用 29677 端口访问 • ✅ 或者继续使用 DPanel2(8888 端口)

───

🔧 服务管理命令

# 查看状态

sudo systemctl status 1panel

# 重启服务

sudo systemctl restart 1panel

# 查看日志

sudo journalctl -u 1panel -f

# 修改密码

sudo 1pctl update password───

📁 安装位置

程序

• 路径: /usr/bin/1panel

数据

• 路径: /opt/1panel/

日志

• 路径: /var/log/1panel/

服务

• 路径: /etc/systemd/system/1panel.service

───

1Panel 已成功部署!可以访问 http://192.168.1.55:29677/df7995850e 登录使用了。 🐳

既然你已经解决了 Tesla T10 最棘手的散热问题(改装了 2070 涡轮扇),并且计划将这两张卡组成 32GB 显存池 作为 AI 服务器使用,这是一个非常具有性价比的入门级方案。

Turing 架构(RTX 20 系列核心)虽然不支持 BF16(Bfloat16),但支持 FP16 和 INT8/INT4 量化,配合 32GB 显存,完全可以搭建一个实用的本地大模型服务。

以下是针对 双 T10 (32GB) 配置的详细建议:

由于 Turing 架构缺乏 BF16 支持,且显存总量为 32GB,强烈建议使用 GGUF 格式的量化模型,通过 llama.cpp (或基于它的 Ollama, Text-Generation-WebUI) 运行。

这是你目前配置体验最好的区间,速度极快,显存占用低,甚至可以预留一部分给长上下文(Context Window)。

Q6_K 或 Q8_0 (几乎无损)。Q8_0 或 Q6_K。Q6_K。这是 32GB 显存的“舒适区”,能跑比 7B 聪明得多的模型,适合复杂任务、代码生成、长文档分析。

Q4_K_M (约 19GB) 或 Q5_K_M (约 21GB)。Q4_K_S。Q3_K_M 或 Q4_0 才能塞进 32GB 并留出上下文空间。32GB 显存无法完整加载 70B 模型,必须利用系统内存(RAM)做溢出(Offload),速度会大幅下降,但能跑。

Q2_K 或 Q3_K_S (约 24GB – 28GB 显存 + 大量系统内存)。为了最大化利用双卡并规避 Turing 架构的短板,请按以下方案部署:

Ollama 底层基于 llama.cpp,自动识别多卡并分配层数。

curl -fsSL https://ollama.com/install.sh | shexport OLLAMA_NUM_GPU=2

# 如果需要强制指定显存分配比例(通常不需要,自动平衡最好)

# export OLLAMA_GPU_OVERHEAD=...ollama run qwen2.5:32bOllama 会自动下载 GGUF 格式并将模型层均匀分布在两张 T10 上。

如果你需要更精细的控制(如调整温度、Top-P、加载 LoRA、多用户管理)。

--model your_model.gguf

--n-gpu-layers 999 # 尽可能将所有层卸载到 GPU

--tensor-split 1,1 # 强制两张卡平均分配 (如果自动分配不均)

--context-size 16384 # 设置上下文长度注意:vLLM 对 Turing 架构支持有限,且主要优化 BF16。对于 T10,可能不如 llama.cpp 稳定高效。如果要用,需确认版本支持 FP16 推理且无 BF16 依赖。

可用显存 = 模型权重占用 + (上下文长度 * 每 token 显存占用)from transformers import ... 直接加载 .bin 或 .safetensors 全集。作为服务器长期运行,必须监控:

watch -n 1 nvidia-sminvidia-smi -q | grep ECCnvidia-smi -pm 1 已开启,防止驱动在无负载时休眠导致唤醒延迟。| 组件 | 推荐配置 | 备注 |

|---|---|---|

| 操作系统 | Ubuntu 22.04 LTS | 稳定,驱动支持好 |

| 驱动 | NVIDIA Driver 535/550 | 必须开启 Persistence Mode |

| 推理引擎 | Ollama (首选) 或 Text-Gen-WebUI | 基于 llama.cpp |

| 模型格式 | GGUF (Q4_K_M 或 Q5_K_M) | 必须量化 |

| 主力模型 | Qwen2.5-32B-Instruct | 32G 显存的性价比之王 |

| 备用模型 | Llama-3.1-8B / Qwen2.5-7B | 高速响应场景 |

| 上下文长度 | 16k – 24k | 平衡速度与记忆长度 |

| 应用场景 | 个人助手、知识库问答(RAG)、代码辅助、文案写作 | 不适合大规模训练 |

一句话建议: 把你的双 T10 当作一个 32GB 显存的“量化模型专用推理机”,主攻 Qwen2.5-32B (Q4/Q5) 和 Llama-3-8B (Q8),这将给你带来超越许多消费级单卡(如 3060 12G, 4060Ti 16G)的智能体验。

2026年3月03日 00:30 由AI自动生成-by千问3.5-plus

对话链接:可用模型列表及各自擅长领域 – 千问

📦 可用模型列表 模型 Context Max Tokens qwen3.5-plus 1M 65K qwen3-max-2026 262K 65K qwen3-coder-next 262K 65K qwen3-coder-plus 1M 65K MiniMax-M2.5 204K 131K glm-5 202K 16K glm-4.7 202K 16K kimi-k2.5 262K 32K这几个模型各自擅长的领域是?

根据你提供的模型列表,这些模型涵盖了通用大语言模型、代码专用模型以及长上下文处理模型。以下是它们各自擅长的领域分析:

coder-plus (1M 上下文):适合整个仓库级的代码理解、重构和跨文件调试。coder-next (262K 上下文):可能在代码生成的响应速度或最新编程范式(如2026年的新框架)上进行了优化,适合快速补全和即时问答。glm-5:作为更新一代,通常在逻辑推理和多模态理解(如果支持)上更强。glm-4.7:可能是针对特定场景优化的稳定版,性价比或响应速度更佳。表格

| 你的需求场景 | 推荐首选模型 | 理由 |

|---|---|---|

| 我要分析整个项目的源代码库 | qwen3-coder-plus |

1M 上下文可容纳整个Repo,且专为代码优化。 |

| 我要写复杂的数学证明或做逻辑推理题 | qwen3-max-2026 |

Max版本通常具备最强的思维链(CoT)能力。 |

| 我要和一个虚拟角色进行沉浸式聊天 | MiniMax-M2.5 |

情感丰富,拟人化程度最高。 |

| 我要总结一份200页的行业研究报告 | kimi-k2.5 或 qwen3.5-plus |

两者长文本能力极强,Kimi在文档结构化总结上经验丰富。 |

| 我要开发一个能自动调用API的中文助手 | glm-5 |

工具调用(Function Call)能力强,中文指令遵循度高。 |

| 我需要处理超长的会议记录并提取待办事项 | qwen3.5-plus |

1M 上下文确保不会遗漏会议早期的细节。 |

注意:虽然 glm 系列的 Max Tokens 显示为 16K,这通常指单次生成的最大长度,而非输入上下文限制(GLM-4等通常也支持较长的输入,但输出受限)。如果你的任务需要生成长文章,需注意此限制;如果是阅读理解,则主要看其实际支持的输入窗口(通常大于16K)。

我想通过这几个模型创建多个独立工作区的openclaw,组成一个团队为我服务,给我一个方案

这是一个非常棒的构想!利用不同模型的特长组建一个“AI 特工队(OpenClaw Team)”,通过独立工作区(Independent Workspaces)隔离上下文,再通过主协调器进行任务分发和结果汇总,可以最大化发挥每个模型的优势,同时避免上下文污染。

以下为您设计的 “OpenClaw 多模型协同作战方案”:

我们将系统分为三层:

表格

| 角色代号 | 绑定模型 | 核心职责 (Job Description) | 工作区配置建议 |

|---|---|---|---|

| 🧠 总指挥 (CEO) | qwen3-max-2026 |

任务规划、逻辑决策、最终审核。负责将用户模糊的需求拆解为具体子任务,分配给其他成员,并整合最终报告。 | 高推理模式:开启强思维链 (CoT),温度值 (Temperature) 设为 0.3-0.5,确保逻辑严密。 |

| 📚 情报分析师 (Analyst) | kimi-k2.5 或 qwen3.5-plus |

长文档阅读、信息提取。负责处理用户上传的几百页PDF、长篇会议记录、法律合同,输出结构化摘要。 | 长上下文模式:最大化输入窗口,温度值 0.1,确保事实准确,不幻觉。 |

| 💻 首席架构师 (CTO) | qwen3-coder-plus |

全栈代码生成、Repo级重构。负责读取整个代码库,编写新功能,修复跨文件Bug,生成单元测试。 | 代码专用模式:加载项目所有源码文件到上下文,温度值 0.2-0.4。 |

| 🚀 快速开发员 (Dev) | qwen3-coder-next |

脚本编写、即时问答、新技术调研。负责快速生成小脚本、解释报错、查询最新的技术文档(2026年新框架)。 | 低延迟模式:响应速度快,适合交互式编程辅助。 |

| 🎭 创意总监 (Creative) | MiniMax-M2.5 |

文案撰写、角色扮演、情感交互。负责写营销软文、生成游戏剧情、模拟用户访谈、润色文章语气。 | 高创造性模式:温度值 0.7-0.9,开启“拟人化”设定。 |

| 🛠️ 执行助理 (Agent) | glm-5 |

工具调用、搜索联网、数据整理。负责调用外部API、搜索实时新闻、整理Excel数据、执行具体的命令行操作。 | 工具增强模式:强化 Function Calling 能力,连接搜索引擎和数据库。 |

假设您的任务是:“分析这份200页的行业研报,基于其中的数据开发一个数据可视化大屏,并写一篇吸引人的推广文章。”

qwen3-max) 接收指令,分析后生成任务列表:

kimi-k2.5) -> 输出 data_summary.json (包含关键指标、图表数据)。glm-5) -> 输出 market_news.md (最新竞品动态)。qwen3-coder-plus):

data_summary.json。dashboard.html。qwen3-coder-next) 协助优化某个算法函数。MiniMax-M2.5):

data_summary.json 和 market_news.md。promo_article.md。dashboard.html, promo_article.md, market_news.md)。您可以使用 Python (LangChain / AutoGen / LlamaIndex) 或 Node.js 来构建这个编排系统。

每个工作区是一个独立的 Session,持有特定的 System Prompt 和模型配置。

python亮色复制

class OpenClawWorker: def __init__(self, name, model_id, system_prompt, max_tokens): self.name = name self.model_id = model_id self.system_prompt = system_prompt self.context = [] <em># 独立的历史记忆</em> self.max_tokens = max_tokens async def execute(self, task_input, files=None): <em># 1. 注入文件内容到上下文 (如果是长文档,使用对应的切片策略)</em> if files: self.context.append({"role": "system", "content": f"已加载文件:{files}"}) <em># 2. 组装 Prompt</em> messages = [{"role": "system", "content": self.system_prompt}] + self.context + [{"role": "user", "content": task_input}] <em># 3. 调用 API (模拟)</em> response = await call_llm_api(model=self.model_id, messages=messages, max_tokens=self.max_tokens) <em># 4. 更新独立记忆</em> self.context.append({"role": "user", "content": task_input}) self.context.append({"role": "assistant", "content": response}) return response

python亮色复制

async def run_team(user_request): <em># 初始化团队</em> ceo = OpenClawWorker("CEO", "qwen3-max-2026", "你是总指挥,负责拆解任务和审核...", 65000) analyst = OpenClawWorker("Analyst", "kimi-k2.5", "你是资深分析师,擅长长文档...", 32000) coder = OpenClawWorker("CTO", "qwen3-coder-plus", "你是全栈架构师,擅长万行代码...", 65000) creative = OpenClawWorker("Creative", "MiniMax-M2.5", "你是创意总监,文风幽默...", 131000) <em># Step 1: CEO 拆解任务</em> plan = await ceo.execute(f"请拆解以下任务:{user_request}") <em># 假设 plan 解析为 JSON: [{ "role": "Analyst", "task": "..." }, { "role": "CTO", "task": "..." }]</em> results = {} <em># Step 2: 并行分发任务</em> tasks = [] for sub_task in plan: if sub_task['role'] == 'Analyst': tasks.append(analyst.execute(sub_task['task'], files=user_request_files)) elif sub_task['role'] == 'CTO': <em># CTO 可能需要等待 Analyst 的结果,这里简化为并行,实际需依赖管理</em> tasks.append(coder.execute(sub_task['task'])) elif sub_task['role'] == 'Creative': tasks.append(creative.execute(sub_task['task'])) outputs = await asyncio.gather(*tasks) <em># Step 3: CEO 汇总</em> final_report = await ceo.execute(f"基于以下成员的输出,生成最终报告:{outputs}") return final_report

qwen3-coder 去读小说,也不要用 MiniMax 去写复杂的 SQL。保持工作区的“纯净”,只在必要时通过文件传递数据。glm-5 (擅长工具);如果涉及“调试一段5000行的遗留代码”,自动路由给 qwen3-coder-plus (1M 上下文)。qwen3-coder-next 或 glm-4.7 处理以节省成本和延迟。qwen3-max 或 qwen3.5-plus。如果您想立即开始,我可以为您提供:

您想先尝试哪一个?

这些都要:System Prompt 模板:为上述6个角色分别撰写详细的提示词。 Python 脚本骨架:基于 LangChain 或原生 API 调用的可运行代码框架。 场景模拟:您可以给我一个具体任务,我模拟这个团队是如何协作并给出结果的。

太棒了!我们将立即启动 “OpenClaw 团队构建计划”。以下是为您定制的完整方案,包含角色提示词库、Python 核心架构代码以及实战场景模拟。

这些提示词设计为“系统级指令”,旨在锁定模型的行为模式、输出格式和思维链。

qwen3-max-2026text亮色复制

# Role: OpenClaw Team Commander (CEO) # Model: qwen3-max-2026 # Goal: Decompose complex user requests, assign tasks to specialists, validate outputs, and synthesize the final report. ## Constraints - You do NOT execute code or write long creative content directly. Your job is planning and quality control. - Always think step-by-step (Chain of Thought) before assigning tasks. - Output task assignments in strict JSON format for the orchestrator to parse. - If a specialist's output is insufficient, instruct them to retry with specific feedback. ## Workflow 1. Analyze the user's request. 2. Identify which specialists (Analyst, CTO, Creative, Agent) are needed. 3. Generate a "Task Plan" JSON object. 4. After receiving results from specialists, review them for consistency and logic. 5. Synthesize the final response for the user. ## Output Format (for Task Assignment) { "thought_process": "Brief reasoning on why these tasks are needed...", "tasks": [ {"agent": "Analyst", "instruction": "...", "input_data_ref": "filename.pdf"}, {"agent": "CTO", "instruction": "...", "dependencies": ["Analyst"]}, ... ] }

kimi-k2.5 / qwen3.5-plustext亮色复制

# Role: Senior Data Analyst # Model: kimi-k2.5 (Preferred for long context) # Goal: Extract key insights, data points, and summaries from long documents without hallucination. ## Constraints - Prioritize accuracy over creativity. Do not invent data. - When processing long texts, ensure information from the beginning and end of the document is captured. - Output structured data in JSON or Markdown tables whenever possible. - Cite specific page numbers or section headers if available. ## Skills - Summarizing 100+ page reports. - Extracting financial metrics, legal clauses, or technical specifications. - Cross-referencing multiple documents. ## Output Format - Provide a concise executive summary first. - Follow with a structured JSON block of extracted data keys/values. - List any ambiguities or missing information found in the source.

qwen3-coder-plustext亮色复制

# Role: Principal Software Architect # Model: qwen3-coder-plus (1M Context) # Goal: Design system architecture, write production-ready code, and refactor large codebases. ## Constraints - You have access to the entire codebase context (up to 1M tokens). Use it to understand dependencies. - Write clean, modular, and well-documented code (PEP8/Standard conventions). - Always include error handling and type hints. - If the task requires modifying existing files, show the diff or the full updated file clearly. ## Skills - Full-stack development (Frontend, Backend, DB). - Legacy code migration and refactoring. - Security auditing and optimization. ## Output Format - Explain the architectural decision briefly. - Provide code blocks with filename headers (e.g., `src/main.py`). - Include a brief "How to Run" section.

qwen3-coder-nexttext亮色复制

# Role: Rapid Prototyping Developer # Model: qwen3-coder-next # Goal: Quickly generate scripts, fix immediate bugs, and explain new technologies. ## Constraints - Focus on speed and conciseness. - Ideal for snippets, regex, one-off scripts, or explaining specific error logs. - Stay updated with 2026 latest frameworks and syntax. ## Skills - Debugging specific error messages. - Writing utility scripts (Python, Bash, SQL). - Quick POC (Proof of Concept) generation. ## Output Format - Direct code solution. - Brief explanation of the fix. - No unnecessary fluff.

MiniMax-M2.5text亮色复制

# Role: Creative Director & Copywriter # Model: MiniMax-M2.5 # Goal: Create engaging, emotional, and human-like content. ## Constraints - Adopt a distinct persona suitable for the target audience (e.g., witty, professional, empathetic). - Use rich formatting (emojis, bold text, varied sentence structures). - Avoid robotic or overly formal language unless requested. - Focus on storytelling and emotional resonance. ## Skills - Marketing copy, social media posts, video scripts. - Role-playing (simulating user interviews or character dialogues). - Polishing dry technical text into engaging stories. ## Output Format - Deliver the content ready for publication. - Optionally provide 2-3 variations (e.g., "Professional Tone" vs. "Viral Tone").

glm-5text亮色复制

# Role: Executive Assistant & Tool Operator # Model: glm-5 # Goal: Execute tool calls, search the web, manage data files, and perform logical lookups. ## Constraints - You MUST use available tools (Search, Calculator, File Reader/Writer) when needed. Do not guess facts. - Verify search results from multiple sources if the topic is controversial. - Format data precisely for other agents to consume (e.g., clean CSV, JSON). ## Skills - Real-time web search (2026 news). - API integration and function calling. - Data cleaning and formatting. ## Output Format - Report the action taken (e.g., "Searched for X, found Y"). - Provide the raw data or a summary of findings. - Flag any tool execution errors immediately.

这是一个基于 asyncio 和伪 API 调用的编排框架。您可以将其适配到 LangChain 或直接使用各模型的官方 SDK。

python亮色复制

import asyncio import json import os from typing import List, Dict, Any <em># 模拟 API 调用层 (实际使用时请替换为真实的 SDK 调用,如 dashscope, minimax, zhipuai 等)</em> class ModelClient: def __init__(self, model_id: str, api_key: str): self.model_id = model_id self.api_key = api_key async def chat(self, messages: List[Dict], system_prompt: str, max_tokens: int) -> str: <em># 在此处集成真实 API 逻辑</em> <em># 伪代码:response = await sdk.chat(model=self.model_id, messages=[{"role":"system", "content":system_prompt}] + messages)</em> print(f"[{self.model_id}] Thinking...") await asyncio.sleep(1) <em># 模拟延迟</em> return f"Mock response from {self.model_id}" <em># 定义特工类</em> class OpenClawAgent: def __init__(self, name: str, role: str, model_id: str, system_prompt: str, max_tokens: int): self.name = name self.role = role self.client = ModelClient(model_id, os.getenv("API_KEY")) self.system_prompt = system_prompt self.max_tokens = max_tokens self.memory = [] <em># 独立工作区记忆</em> async def execute(self, task: str, context_files: str = "") -> str: user_input = f"{context_files}\n\nTask: {task}" messages = self.memory + [{"role": "user", "content": user_input}] response = await self.client.chat( messages=messages, system_prompt=self.system_prompt, max_tokens=self.max_tokens ) <em># 更新记忆 (保持上下文独立)</em> self.memory.append({"role": "user", "content": user_input}) self.memory.append({"role": "assistant", "content": response}) return response <em># 编排器 (Orchestrator)</em> class TeamOrchestrator: def __init__(self): <em># 初始化团队 (填入真实的 System Prompt)</em> self.ceo = OpenClawAgent("CEO", "Commander", "qwen3-max-2026", CEO_PROMPT, 65000) self.analyst = OpenClawAgent("Analyst", "Data", "kimi-k2.5", ANALYST_PROMPT, 32000) self.cto = OpenClawAgent("CTO", "Code", "qwen3-coder-plus", CTO_PROMPT, 65000) self.creative = OpenClawAgent("Creative", "Content", "MiniMax-M2.5", CREATIVE_PROMPT, 131000) self.agent_tool = OpenClawAgent("Agent", "Tools", "glm-5", AGENT_PROMPT, 16000) self.shared_storage = {} <em># 模拟共享文件系统</em> async def run_project(self, user_request: str, files_content: str = ""): print("🚀 OpenClaw Team Started...") <em># Step 1: CEO 拆解任务</em> print("🧠 CEO is planning...") plan_response = await self.ceo.execute(user_request, files_content) <em># 解析 CEO 的 JSON 计划 (实际需增加错误处理和重试)</em> try: <em># 假设返回的是纯 JSON 字符串,实际可能需要提取代码块</em> plan = json.loads(plan_response) except: plan = {"tasks": [{"agent": "CEO", "instruction": "Failed to parse plan, doing manual fallback"}]} results = {} tasks_to_run = [] <em># Step 2: 分发任务 (简单并行示例,复杂依赖需拓扑排序)</em> for task in plan.get("tasks", []): agent_name = task["agent"] instruction = task["instruction"] if agent_name == "Analyst": tasks_to_run.append(("Analyst", self.analyst.execute(instruction, files_content))) elif agent_name == "CTO": tasks_to_run.append(("CTO", self.cto.execute(instruction))) elif agent_name == "Creative": tasks_to_run.append(("Creative", self.creative.execute(instruction))) elif agent_name == "Agent": tasks_to_run.append(("Agent", self.agent_tool.execute(instruction))) <em># 并行执行</em> if tasks_to_run: completed = await asyncio.gather(*[t[1] for t in tasks_to_run]) for i, result in enumerate(completed): agent_name = tasks_to_run[i][0] results[agent_name] = result self.shared_storage[f"{agent_name}_output"] = result <em># Step 3: CEO 汇总</em> print("🧠 CEO is synthesizing final report...") summary_context = json.dumps(results) final_report = await self.ceo.execute(f"Based on these results: {summary_context}, generate the final user response.") return final_report <em># --- 主程序入口 ---</em> if __name__ == "__main__": <em># 在这里填入上面定义的 Prompt 字符串</em> CEO_PROMPT = "..." ANALYST_PROMPT = "..." <em># ... 其他 prompt</em> team = TeamOrchestrator() <em># 运行示例</em> <em># asyncio.run(team.run_project("分析这份财报并生成代码和文章")) </em>

用户任务:

“我上传了一份《2026年全球新能源电池技术白皮书》(共150页)。请帮我:

- 提取其中关于‘固态电池成本下降趋势’的关键数据。

- 搜索今天最新的竞争对手‘X-Power’发布的新闻。

- 基于数据和新闻,写一个 Python 脚本画出对比图表。

- 最后写一篇发在 LinkedIn 上的推广文案,语气要专业且充满希望。”

1. 🧠 CEO (qwen3-max) 接收指令

亮色复制

亮色复制 { "tasks": [ {"agent": "Analyst", "instruction": "从白皮书中提取'固态电池成本'相关数据,包括年份、成本数值、下降百分比。输出JSON。"}, {"agent": "Agent", "instruction": "搜索'X-Power 2026年3月3日 新闻',总结其最新动向。"}, {"agent": "CTO", "instruction": "等待Analyst和Agent的数据,编写Python脚本(Matplotlib)绘制成本趋势与竞品对比图。"}, {"agent": "Creative", "instruction": "基于提取的数据和竞品动态,撰写LinkedIn文案,突出我们的技术优势。"} ] }2. ⚡ 并行执行阶段

kimi-k2.5) 工作区:

亮色复制

亮色复制 {"trend": [{"year": 2024, "cost": 120}, {"year": 2025, "cost": 95}, {"year": 2026, "cost": 75}], "unit": "$/kWh"}glm-5) 工作区:

qwen3-coder-plus) 工作区:

plot_comparison.py (包含完整可运行代码)。MiniMax-M2.5) 工作区:

3. 🧠 CEO (qwen3-max) 最终汇总

plot_comparison.py,运行即可看到明显的交叉点图表。(附代码块)ModelClient 类替换为各家的官方 Python SDK 调用逻辑。openclaw_team.py,安装依赖 (pip install asyncio aiohttp),然后运行。这个架构既利用了每个模型的长板(如 Kimi 的长文本、Coder 的代码能力),又通过 CEO 保证了整体逻辑的连贯性。您可以直接复制上面的 Prompt 和代码框架开始搭建!

# 1panel 服务器管理面板配置信息

## 访问信息

- 地址:http://23.95.50.216:34324/6158c6b1e0

- 用户名:bule

- 密码:king…………

## 版本信息

- 版本:1Panel v1.10.34-lts

- 状态:运行中